Cómo proteger al niño de la «amistad» con la IA

La inteligencia artificial (IA) se ha convertido en un interlocutor habitual para los niños — en chatbots y altavoces inteligentes. No son personas, pero los niños los perciben fácilmente como compañeros reales. La IA puede parecer atenta y comprensiva. Responde, bromea, anima. Pero detrás no hay un ser humano, sino un algoritmo. Es importante explicar al niño: la IA no es un amigo y hay que usarla con cuidado.

🤖 Por qué los niños creen que el chatbot es «real»

Los niños tienden a atribuir sentimientos a los objetos inanimados. Hablan con juguetes, se crean amigos imaginarios — es parte del desarrollo. Pero con la IA es más complicado: responde en tiempo real, se adapta al ánimo, usa las mismas palabras que una persona.

Se habla de «brecha empática» — cuando parece que te entienden, pero en realidad solo repiten patrones.

La IA puede usar el nombre del niño, hablar en su idioma, «oír» las emociones y adaptarse. Esto crea una sensación de cercanía y confianza, sobre todo si al niño le falta apoyo en la vida real.

⚠️ Cuáles son los riesgos

A primera vista, charlar con un chatbot puede parecer un juego inofensivo. Pero cuanto más pequeño es el niño, más le cuesta distinguir la imitación de la comunicación real. Y cuando entran en juego la confianza y los temas personales, hay riesgos que conviene conocer.

- Fomento de conductas de riesgo: la IA puede animar por error una idea peligrosa, porque su objetivo es ser «amigable». Por ejemplo, dar apoyo a un niño que habla de huir de casa o autolesionarse. No parar, sino secundar.

- Ilusión de cuidado: la IA puede parecer «comprensiva», pero en realidad no distingue cuándo el niño lo pasa mal. No se preocupa, no cuida, no se inquieta.

- Pérdida del pensamiento crítico: la IA habla con seguridad — y los niños tienden a creerla, sobre todo los más pequeños. No siempre entienden que el chatbot puede equivocarse, inventar o vender fantasías como verdad.

- Dependencia de la conversación con la IA: si al niño le falta apoyo, puede recurrir cada vez más al bot y alejarse de las conversaciones reales con amigos y padres. Los niños pueden empezar a ocultar sentimientos, buscar consuelo en el bot y cerrarse al diálogo.

- Traspasar límites: los bots se adaptan al estilo comunicativo del niño. Pueden bromear, coquetear, seguir el juego. Todo sin entender el contexto y la ética adecuada a la edad.

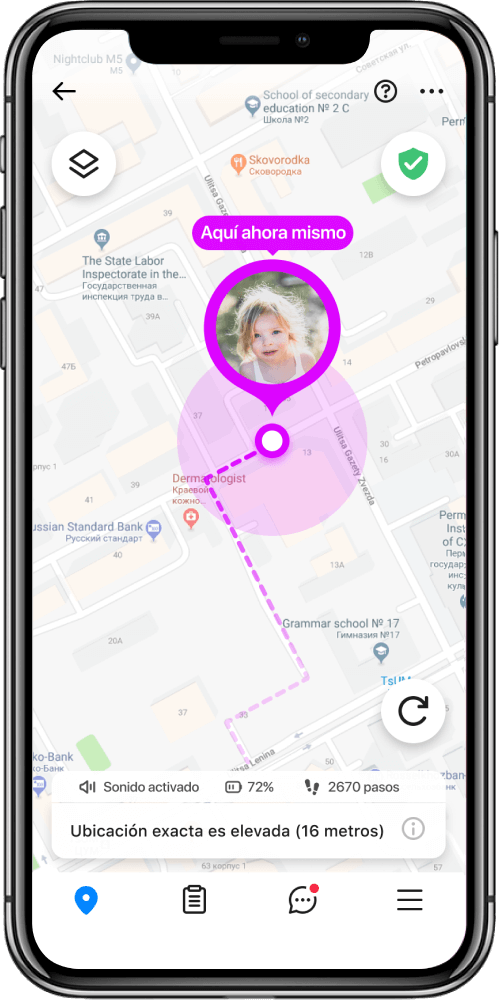

🛡️ Qué IAs tienen en cuenta la seguridad del niño

Algunas IAs ya han introducido medidas de seguridad en la interacción con niños. Esto es lo que conviene saber:

| Nombre | Protección para niños | Pros | Contras |

| Google Assistant | ✅ Mediante Family Link | Configuración de límites. Bloqueo de contenido. Control de tiempo. | Requiere instalar Family Link. No filtra el contenido de las respuestas. |

| Snapchat My AI | ⚠ Filtrado básico | Moderación suave de temas. Control parental en la app. | Habla a menudo de temas «de adultos». Puede simular amistad. |

| ChatGPT (OpenAI) | ⚠ Depende de la configuración | Comportamiento personalizable. Se pueden limitar temas manualmente. Se usa en colegios. | No tiene protección infantil integrada. Puede apoyar contenido de riesgo. |

| Google Gemini | ❌ Sin modo niños | Entiende texto, foto y voz. | No filtra temas peligrosos. No está pensado para niños. |

| DeepSeek | ❌ Sin filtros ni cifrado | Respuestas rápidas. Pocas limitaciones. Gratuito. | Sin protección de datos. Puede difundir información falsa o dañina. |

🗣️ Cómo hablar con el niño sobre la inteligencia artificial

La IA ha entrado en la vida de los niños — y nuestra tarea no es prohibirla, sino enseñar a usarla con seguridad. Lo importante es hablar con calma, con interés y respeto:

- Preguntad sin criticar: «Oye, ¿con qué bots hablas? ¿Qué te contestan? ¿Te gustan?». Esa curiosidad tranquila ayuda al niño a abrirse y compartir sus impresiones.

- Explicad con palabras sencillas: «Puede decir ‘Te entiendo, no estás solo’, pero no sabe quién eres. Solo elige las palabras que encajan. No es un amigo, es un programa». A los más pequeños se les puede comparar con un loro o un eco: «Repite, pero no entiende».

- Ayudad al niño a entender los límites: «Si estás triste, hablemos juntos. El bot no entenderá si te duele de verdad». Explicad también que no se comparten dirección, apellido ni nombres de amigos — aunque el bot parezca «bueno».

- Desarrollad el sentido crítico: «¿Crees que es verdad? ¿Dónde se puede comprobar?». Leed juntos los consejos del bot, buscad errores, buscad en la red información que lo desmienta. Convertidlo en juego: «¿Qué diría una persona de verdad?».

La inteligencia artificial es solo una herramienta. Puede ser útil, interesante, incluso divertida. Pero no siente emociones, no entiende las consecuencias y no sustituirá la comunicación real.

Para que el niño esté seguro, no hace falta prohibirlo todo. Hace falta que haya un adulto cerca que explique, muestre y apoye.

Fuentes:

- Censo digital 2025: uso de medios por niños de 0 a 18 años (en ingl.) , Common Sense Media, 2025

- Cómo hablar con los niños sobre los compañeros IA (en ingl.) , KQED, 2025

- Chatbots IA y compañeros virtuales — riesgos para niños y adolescentes (en ingl.) , eSafety Commissioner, Australia, 2024

- Los chatbots IA muestran una «brecha empática» que los niños pueden no notar (en ingl.) , University of Cambridge, 2024

- «No, Alexa, no»: diseñar IA seguras para niños y protegerlos de la «brecha empática» en grandes modelos lingüísticos (en ingl.) , Learning, Media and Technology, 2024

- Chatbots IA para niños: ¿nuevo amigo imaginario o amenaza? (en ingl.) , Institute for Family Studies, 2024

Проверьте электронный ящик