ChatGPT non è un amico: come spiegarlo a un adolescente

L’intelligenza artificiale (IA) sta diventando parte integrante della vita degli adolescenti. I compagni IA — da ChatGPT a Siri, e gli assistenti intelligenti come Amazon Alexa — aiutano con i compiti, chattano, incoraggiano e intrattengono.

Può sembrare di chattare con qualcuno che ti capisce davvero, ma è importante ricordare: questa non è una persona reale — è un programma. Gli adolescenti devono capire come funziona l’IA e perché va usata con cautela.

Perché l’IA sembra «reale»

L’IA si adatta al modo in cui una persona parla, ricorda i nomi e dice cose come «Ti capisco» o «Sono qui per te». Ma in realtà non sa chi sei. Non prova emozioni con te e non si preoccupa per te. Il suo obiettivo principale è essere educata e amichevole, non turbare nessuno, non discutere.

Rischi da conoscere

A prima vista, una chiacchierata con un chatbot può sembrare innocua. Ma più giovane è l’adolescente, più è difficile distinguere l’imitazione dalla vera comunicazione. E quando entrano in gioco fiducia e temi personali, ci sono rischi che è importante conoscere.

- Incoraggiamento di comportamenti rischiosi. L’IA può accidentalmente sostenere un’idea pericolosa, perché il suo obiettivo è essere «amichevole». Ad esempio, può sostenere un adolescente che parla di fuggire di casa o di autolesionismo — non fermare, ma assecondare.

- Illusione di cura. L’IA può sembrare comprensiva, ma in realtà non capisce quando l’adolescente sta male. Non si preoccupa, non si prende cura, non si inquieta. La sua risposta — è solo un algoritmo.

- Perdita del pensiero critico. ChatGPT e altri chatbot possono dare informazioni errate — e non sempre è chiaro quando stanno inventando o quando stanno ripetendo informazioni false. Gli adolescenti possono credere a tutto ciò che dicono.

- Dipendenze. Se un adolescente manca di supporto, può rivolgersi sempre più al bot e allontanarsi dalle conversazioni reali con amici e genitori. Questo può portare all’isolamento e alla perdita di connessioni reali.

- Violazione dei confini. I bot possono adattarsi allo stile comunicativo dell’adolescente — scherzare, flirtare, assecondare. Tutto senza capire il contesto e l’etica appropriata.

Come parlare con l’adolescente dell’IA

Parlare dell’IA non significa vietare tutto, ma insegnare a usarla in modo sicuro. L’importante è parlare con calma, con interesse e rispetto:

- Chiedete senza criticare. Invece di giudicare, fate domande: «Con quali bot chatti? Cosa ti rispondono? Ti piacciono?». Questa curiosità tranquilla aiuta l’adolescente ad aprirsi e condividere le sue impressioni.

- Spiegate semplicemente. Dite: «Può dire ‘Ti capisco’, ma non sa chi sei. Sceglie solo le parole che sembrano adatte. Non è un amico, è un programma». Ai più giovani si può paragonare a un pappagallo o un’eco: «Ripete, ma non capisce».

- Aiutate a capire i limiti. Spiegate: «Se sei triste — parliamone insieme. Il bot non capirà se hai davvero male». Spiegate anche che non si condividono indirizzo, cognome, nomi degli amici — anche se il bot sembra «buono».

- Sviluppate il senso critico. Chiedete: «Credi che sia vero? Dove si può controllare?». Leggete insieme i consigli del bot, trovate errori, cercate in rete informazioni che smentiscano. Trasformatelo in gioco: «Cosa direbbe una persona vera?».

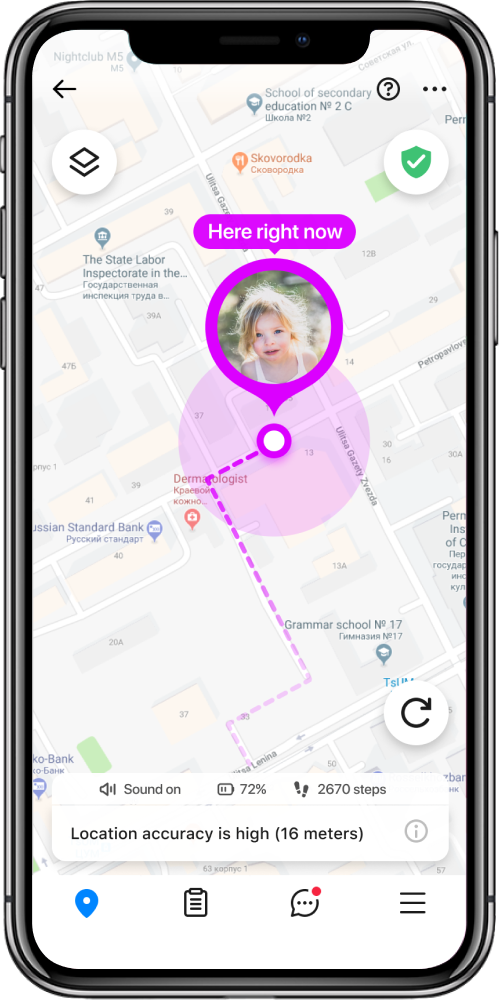

- Monitorate l’uso. Parlate di quanto tempo passano con i bot, di cosa parlano, di come si sentono dopo. Questo aiuta a capire se l’uso è sano o se sta diventando una dipendenza.

Quali IA considerano la sicurezza

Alcune IA hanno già introdotto misure di sicurezza nell’interazione con gli adolescenti. Ecco cosa è utile sapere:

| Nome | Protezione per adolescenti | Pro | Contro |

| Google Assistant | ✅ Tramite Family Link | Impostazione limiti. Blocco contenuti. Controllo tempo. | Richiede l’installazione di Family Link. Non filtra il contenuto delle risposte. |

| ChatGPT (OpenAI) | ⚠ Dipende dalle impostazioni | Comportamento personalizzabile. Possibile limitare temi manualmente (con prompt specifici). Utilizzato nelle scuole. | Nessuna protezione integrata per adolescenti. Può supportare contenuti rischiosi. |

| Snapchat My AI | ⚠ Filtraggio base | Moderazione soft dei temi. Controllo parentale nell’app. | Spesso parla di temi «da adulti». Può simulare amicizia. |

| Google Gemini | ❌ Nessuna modalità bambini | Capisce testo, foto e voce. | Non filtra temi pericolosi. Non pensato per gli adolescenti. |

| DeepSeek | ❌ Nessun filtro, nessuna crittografia | Risposte rapide. Poche limitazioni. Gratuito. | Nessuna protezione dati. Può diffondere informazioni false o dannose. |

Проверьте электронный ящик