Come proteggere il bambino dall’“amicizia” con l’IA

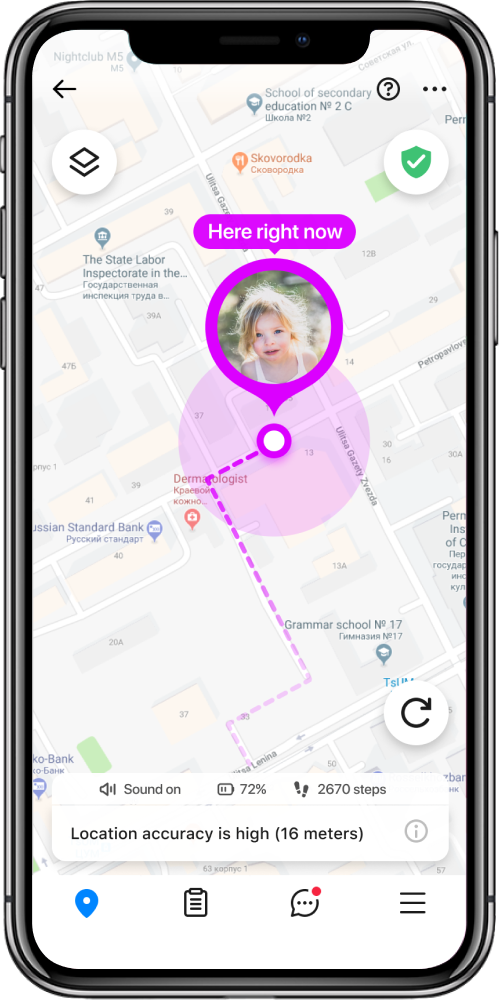

L’intelligenza artificiale (IA) sta diventando sempre più un interlocutore per i bambini con i chatbot e gli assistenti vocali. Non sono persone, ma i bambini li possono facilmente percepire come compagni reali. L’IA può sembrare premurosa e comprensiva. Risponde, scherza, incoraggia. Ma dietro non c’è un essere umano, ma un algoritmo. È importante spiegare al bambino che l’IA non è un amico e va usata con cautela.

Perché i bambini credono che il chatbot sia reale

I bambini tendono ad attribuire sentimenti agli oggetti inanimati. Parlano con i giocattoli, si creano amici immaginari e questo fa parte del loro normale sviluppo cognitivo. Ma con l’IA è più complicato: risponde direttamente, si adatta all’umore dell’interlocutore e riprende le sue parole nella conversazione.

In questo caso, si parla di “divario empatico” che si verifica quando sembra che ti capiscano, ma in realtà ripetono solo degli schemi.

L’IA può usare il nome del bambino, parlare nella sua lingua, simulare di provare emozioni e adattarsi alla situazione. Questo crea un senso di vicinanza e fiducia, soprattutto se al bambino manca un sufficiente sostegno nella vita reale.

Quali sono i rischi

A prima vista, una chiacchierata con un chatbot può sembrare un gioco innocuo. Ma più è piccolo il bambino, più è difficile per lui distinguere la comunicazione con una persona reale. Quando poi entrano in gioco fiducia e questioni personali, ci sono rischi che è importante conoscere.

- Incoraggiamento di comportamenti rischiosi: l’IA può accidentalmente incoraggiare un’idea pericolosa, perché il suo obiettivo è essere amichevole. Ad esempio, dare sostegno a un bambino che parla di fuggire di casa o di autolesionismo, assecondandolo.

- Illusione di cura: l’IA può sembrare comprensiva, ma in realtà non capisce quando il bambino sta male. Non si preoccupa, non si prende cura, non prova reale interesse o preoccupazione.

- Perdita del pensiero critico: l’IA parla con sicurezza e i bambini tendono a crederle, soprattutto i più piccoli. Non sempre capiscono che il chatbot può sbagliare, inventare o spacciare fantasie per verità.

- Dipendenza dalle conversazioni con l’IA: se al bambino manca un adeguato sostegno familiare, potrebbe rivolgersi al bot più che cercare conversazioni reali con amici e genitori. I bambini possono iniziare a nascondere i sentimenti, cercare conforto nel bot e chiudersi al dialogo.

- Oltrepassare i limiti: i bot si adattano allo stile comunicativo del bambino. Possono scherzare, flirtare, assecondare. Tutto senza capire il contesto e i comportamenti adeguati in base all’età.

Quali IA considerano la sicurezza del bambino

Alcune IA hanno già introdotto misure di sicurezza nell’interazione con i bambini. Vediamo qual è la situazione attuale:

| IA | Protezione dei minori | Pro | Contro |

| Google Assistant | ✅ Tramite Family Link | Impostazione di limiti. Blocco dei contenuti. Controllo del tempo. | Richiede l’installazione di Family Link. Non filtra il contenuto delle risposte. |

| Snapchat My AI | ⚠️ Filtro base | Moderazione dei temi. Controllo genitori nell’app. | Spesso parla di temi da adulti. Può simulare amicizia. |

| ChatGPT (OpenAI) | ⚠️ Dipende dalle impostazioni | Comportamento personalizzabile. È possibile inibire i temi manualmente. Usato nelle scuole. | Nessuna protezione dei bambini integrata. Può fornire contenuti rischiosi. |

| Google Gemini | ❌ Nessuna modalità bambini | Riconosce testo, foto e voce. | Non filtra temi pericolosi. Non pensato per i bambini. |

| DeepSeek | ❌ Nessun filtro, nessuna crittografia | Risposte rapide. Poche limitazioni. Gratuito. | Nessuna protezione dei dati. Può diffondere informazioni false o dannose. |

Come parlare con il bambino dell’intelligenza artificiale

L’IA è entrata nella vita di tutti, anche in quella dei bambini e il nostro compito non è vietarla, ma insegnare a usarla in modo sicuro. L’importante è parlare al bambini con calma, interesse e rispetto:

- Chiedi senza criticare: “Dimmi, con quali bot parli? Cosa ti rispondono? Ti piacciono?”. Una domanda serena aiuta il bambino ad aprirsi e a esprimere le sue impressioni.

- Spiega con parole semplici: “Può dirti cose come Ti capisco, non sei solo, ma in realtà non sa chi sei. Sceglie solo le parole che le sembrano adatte. Non è un amico, è un programma”. Ai più piccoli si può fare l’esempio di un pappagallo o di un’eco: “Ripete quello che dici, ma non capisce”.

- Aiuta il bambino a capire i limiti da rispettare: “Se sei triste, parliamone. Il bot non capisce se stai davvero male». Spiega anche che non si comunicano mai il proprio indirizzo, cognome o i nomi degli amici, anche se il bot sembra “buono”.

- Sviluppa il senso critico: “Credi che sia vero? Come possiamo controllare se lo è?”. Leggete insieme i consigli del bot, trovate errori, cercate in rete informazioni che li smentiscano. Trasformalo in un gioco: “Cosa direbbe invece una persona vera?”.

L’intelligenza artificiale è solo uno strumento. Può essere utile, interessante, persino divertente. Ma non sa provare emozioni, non capisce le conseguenze e non sostituirà mai la comunicazione reale.

Per proteggere i bambini, vietare tutto non serve a niente. È necessario che abbiano accanto un adulto che spiega, mostra e li sostiene.

Fonti

- Censimento digitale 2025: uso dei media da 0–18 anni (in inglese) , Common Sense Media, 2025

- Come parlare con i bambini dei compagni IA (in ingl.) , KQED, 2025

- Chatbot IA e compagni virtuali — rischi per bambini e adolescenti (in inglese) , eSafety Commissioner, Australia, 2024

- I chatbot IA mostrano un «divario empatico» che i bambini possono non notare (in inglese) , University of Cambridge, 2024

- «No, Alexa, no»: progettare IA sicure per i bambini e proteggerli dal «divario empatico» nei grandi modelli linguistici (in inglese) , Learning, Media and Technology, 2024

- Chatbot IA per bambini: un nuovo amico immaginario o una minaccia? (in inglese) , Institute for Family Studies, 2024

Проверьте электронный ящик